आर्टिफिशियल इंटेलिजेंस (AI) की दुनिया में, Deep Learning एक बहुत ही powerful branch है जिसने हाल के वर्षों में कई remarkable advancements किए हैं। AI की सबसे fascinating capabilities में से एक है नए और original data को generate करने की क्षमता, और यहीं पर Generative Models काम आते हैं। इन मॉडल्स में से एक बेहद प्रभावशाली और लोकप्रिय तकनीक है Variational Autoencoders (VAEs)। VAEs सिर्फ डेटा को analyze नहीं करते, बल्कि वे समझते हैं कि डेटा कैसे बना है और फिर बिल्कुल नया, realistic डेटा खुद generate कर सकते हैं। यह article आपको VAEs की गहराई में ले जाएगा, उनकी fundamental workings से लेकर उनके real-world applications तक, ताकि आप इस cutting-edge AI तकनीक को बेहतर ढंग से समझ सकें।

Generative Models और उनका महत्व

Deep Learning में, मॉडल्स को आम तौर पर दो मुख्य categories में बांटा जा सकता है: Discriminative Models और Generative Models। Discriminative Models का काम डेटा को classify करना या predictions करना होता है, जैसे कि एक image में बिल्ली या कुत्ते को पहचानना। वहीं, Generative Models का लक्ष्य कुछ नया बनाना होता है – यह कोई नई image, text या audio हो सकता है।

Generative Models का महत्व बहुत गहरा है। वे हमें synthetic data बनाने की अनुमति देते हैं, जिसका उपयोग training datasets को बढ़ाने, privacy-sensitive applications के लिए anonymized data बनाने, या यहाँ तक कि creative arts और design में भी किया जा सकता है। ये मॉडल डेटा के अंतर्निहित पैटर्न (underlying patterns) और structure को सीखते हैं, जिससे वे मौजूदा डेटासेट से मिलती-जुलती लेकिन पूरी तरह से नई और unique instances generate कर पाते हैं। Generative Adversarial Networks (GANs) और Variational Autoencoders (VAEs) दो सबसे प्रमुख generative architectures हैं, जिनमें VAEs अपनी simplicity और latent space की interpretability के लिए जाने जाते हैं।

Autoencoders को समझना: VAEs की नींव

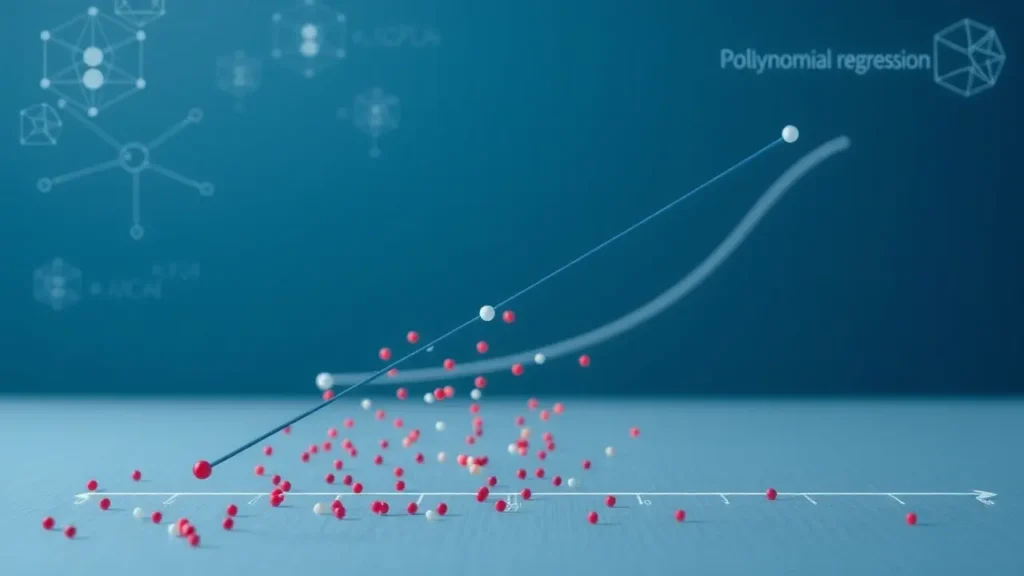

Variational Autoencoders को समझने से पहले, हमें standard Autoencoders को समझना होगा। एक Autoencoder एक प्रकार का neural network है जिसका उपयोग unsupervised learning के लिए किया जाता है। इसका मुख्य उद्देश्य data की dimensionality को कम करना और उसके सबसे essential features को सीखना है।

Autoencoder में दो मुख्य हिस्से होते हैं: एक Encoder और एक Decoder।

- Encoder: यह इनपुट डेटा (जैसे एक image) को लेता है और उसे एक छोटे, compressed representation में बदल देता है, जिसे latent space या bottleneck कहते हैं। यह compressed representation डेटा के सबसे महत्वपूर्ण features को encode करती है।

- Decoder: यह latent space representation को लेता है और उसे वापस मूल इनपुट डेटा के reconstruction में बदलता है।

Autoencoder को इस तरह से train किया जाता है कि उसका reconstruction output, original input के जितना संभव हो उतना करीब हो। इसका मतलब है कि Autoencoder यह सीखता है कि डेटा को प्रभावी ढंग से कैसे compress किया जाए और फिर उसे कैसे decompress किया जाए। हालाँकि, standard Autoencoders का latent space अक्सर “discontinuous” या “sparse” होता है, जिसका अर्थ है कि latent space में randomly sample किए गए points से meaningful data generate करना मुश्किल हो सकता है। यह वह limitation है जिसे VAEs solve करते हैं।

Variational Autoencoders (VAEs) क्या हैं?

Variational Autoencoders (VAEs) standard Autoencoders का एक probabilistic extension हैं। जबकि एक Autoencoder इनपुट डेटा को latent space में एक single point पर encode करता है, एक VAE इनपुट डेटा को latent space में एक probability distribution (यानी, एक mean और एक variance) पर encode करता है।

इसका मतलब यह है कि VAE का encoder एक single fixed value के बजाय, इनपुट डेटा के लिए latent space में संभाव्य वितरण (probabilistic distribution) के parameters (आमतौर पर mean (μ) और log-variance (log σ²)) को आउटपुट करता है। फिर इस distribution से एक point को sample किया जाता है और decoder को दिया जाता है। यह probabilistic approach VAE के latent space को continuous और smooth बनाता है, जिससे इसके किसी भी हिस्से से meaningful data generate करना आसान हो जाता है।

VAEs की एक महत्वपूर्ण अवधारणा Reparameterization Trick है। चूंकि हम एक distribution से sample करते हैं, तो यह process differentiable नहीं होती, जिसका अर्थ है कि हम backpropagation का सीधे उपयोग नहीं कर सकते। Reparameterization Trick इस समस्या को हल करती है। यह हमें sampling operation को latent space के parameters (mean और variance) से अलग करने की अनुमति देती है, जिससे training के दौरान gradients को पास किया जा सके।

VAEs का loss function दो भागों से बना होता है:

- Reconstruction Loss: यह original input और reconstructed output के बीच के अंतर को मापता है, ठीक एक standard Autoencoder की तरह।

- KL Divergence Loss: यह latent space में सीखी गई distribution (mean और variance द्वारा परिभाषित) और एक simple prior distribution (आमतौर पर एक standard normal distribution) के बीच के अंतर को मापता है। यह टर्म latent space को “well-behaved” और continuous रखने में मदद करती है, जिससे नया डेटा generate करना आसान हो जाता है।

इन दोनों losses का संयोजन VAEs को यह सीखने में सक्षम बनाता है कि डेटा को सही ढंग से कैसे reconstruct किया जाए और साथ ही, एक smooth और sampleable latent space को कैसे बनाए रखा जाए।

VAEs के फायदे और Practical Applications

Variational Autoencoders के कई महत्वपूर्ण फायदे हैं जो उन्हें deep learning community में मूल्यवान बनाते हैं:

- Continuous और Structured Latent Space: VAEs का सबसे बड़ा फायदा यह है कि वे एक smooth और continuous latent space सीखते हैं। इसका मतलब है कि आप latent space में किन्हीं भी दो points के बीच interpolation कर सकते हैं और आपको बीच में भी meaningful outputs मिलेंगे। यह नए डेटा generation के लिए बहुत अच्छा है।

- Principled Probabilistic Approach: VAEs एक मजबूत probabilistic framework पर आधारित हैं, जो उन्हें डेटा के underling generative process को समझने में मदद करता है।

- Less Prone to Mode Collapse: GANs की तुलना में, VAEs आमतौर पर ‘mode collapse’ से कम प्रभावित होते हैं, एक ऐसी समस्या जहाँ generative models केवल कुछ प्रकार के आउटपुट ही generate करने लगते हैं।

VAEs के practical applications विविध और प्रभावशाली हैं:

- Image Generation और Manipulation: VAEs realistic images generate कर सकते हैं। Latent space को manipulate करके, हम किसी image की specific features (जैसे चेहरे की expression, बालों का रंग) को बदल सकते हैं।

- Drug Discovery: नए molecular structures generate करने के लिए VAEs का उपयोग किया जा सकता है जिनके वांछित गुण हो सकते हैं, जिससे दवा विकास प्रक्रिया में तेजी आती है।

- Anomaly Detection: चूँकि VAEs सामान्य डेटा के वितरण को सीखते हैं, वे ऐसे डेटा पॉइंट्स की पहचान कर सकते हैं जो इस वितरण से बहुत दूर हैं, जो anomalies या outliers हो सकते हैं।

- Data Imputation: गुम डेटा (missing data) को भरने के लिए VAEs का उपयोग किया जा सकता है, विशेष रूप से ऐसे datasets में जहाँ जटिल dependencies होती हैं।

- Style Transfer: एक image से स्टाइल को निकालकर उसे दूसरी image पर apply करने में भी VAEs का उपयोग किया जाता है।

निष्कर्ष

Variational Autoencoders (VAEs) Deep Learning और Generative Models के क्षेत्र में एक क्रांतिकारी तकनीक हैं। Autoencoders की बुनियादी अवधारणा पर निर्माण करते हुए, VAEs ने एक probabilistic twist जोड़ा है जो उन्हें न केवल डेटा को compress और reconstruct करने की अनुमति देता है, बल्कि एक structured और continuous latent space को भी सीखता है। यह latent space VAEs को पूरी तरह से नया, विविध और realistic डेटा generate करने की शक्ति देता है। Reparameterization Trick और KL Divergence जैसे प्रमुख घटकों ने VAEs को AI के creative side में एक महत्वपूर्ण उपकरण बना दिया है। Image generation से लेकर drug discovery और anomaly detection तक, VAEs विभिन्न real-world scenarios में अपनी बहुमुखी प्रतिभा और क्षमता को साबित कर रहे हैं। जैसे-जैसे AI आगे बढ़ता रहेगा, VAEs निस्संदेह generative AI की frontiers को आगे बढ़ाने में महत्वपूर्ण भूमिका निभाते रहेंगे, जिससे मशीनों को दुनिया को केवल समझने के बजाय उसे बनाने और नया करने में मदद मिलेगी।