आर्टिफिशियल इंटेलिजेंस (AI) हमारे जीवन के हर पहलू को तेज़ी से बदल रहा है। जहाँ एक तरफ AI ने innovation और efficiency के नए रास्ते खोले हैं, वहीं दूसरी तरफ इसके अनियंत्रित विकास से जुड़े कई सवाल और चिंताएँ भी सामने आ रही हैं। AI की ये असीमित क्षमताएँ इसे एक शक्तिशाली tool बनाती हैं, लेकिन इसके साथ ही यह सुनिश्चित करना भी बेहद ज़रूरी हो जाता है कि इसका उपयोग समाज के हित में और नैतिक रूप से हो। इसी वजह से AI regulation और policy का महत्व लगातार बढ़ रहा है। इस लेख में हम AI के भविष्य, इसकी चुनौतियों, और इसे नियंत्रित करने के लिए बन रही नीतियों व नियमों पर विस्तार से चर्चा करेंगे ताकि इसके सकारात्मक प्रभाव को अधिकतम किया जा सके और नकारात्मक प्रभावों को कम किया जा सके।

AI का तेज़ी से विकास और चुनौतियाँ

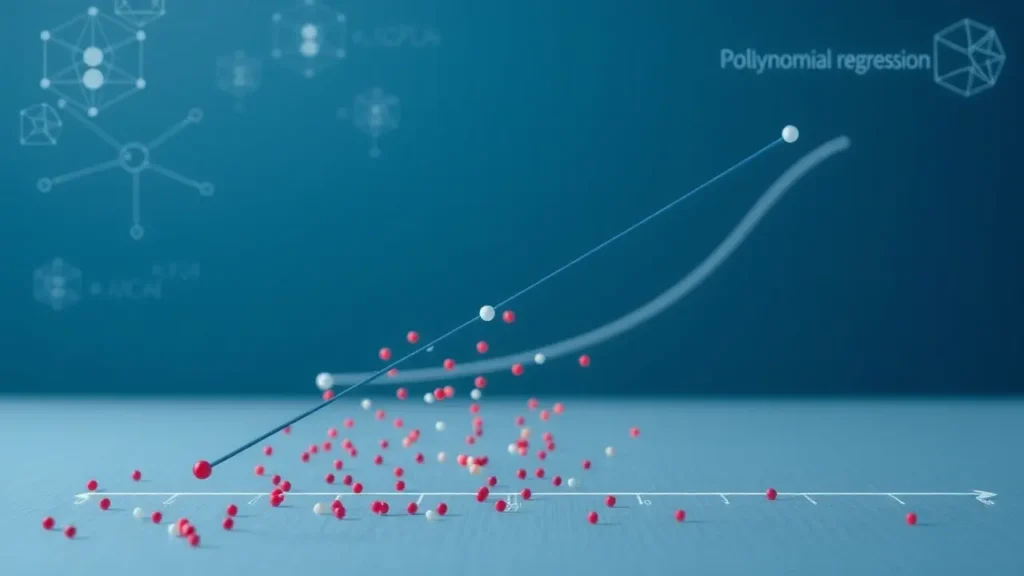

AI technology ने पिछले कुछ सालों में अभूतपूर्व प्रगति की है। मशीन लर्निंग, डीप लर्निंग और नेचुरल लैंग्वेज प्रोसेसिंग जैसे क्षेत्रों में आए advancements ने AI को लगभग हर इंडस्ट्री का एक अभिन्न अंग बना दिया है। Healthcare में बीमारियों का पता लगाने से लेकर finance में fraud detection तक, और autonomous vehicles से लेकर personalised content recommendations तक, AI हमारी रोज़मर्रा की ज़िंदगी का हिस्सा बन चुका है।

लेकिन इस तेज़ विकास के साथ कई गंभीर चुनौतियाँ भी सामने आई हैं।

- Ethical Concerns: AI systems में अक्सर डेटा bias के कारण भेदभाव की समस्या देखी जाती है, जिससे समाज में असमानता बढ़ सकती है।

- Job Displacement: Automation और AI के कारण कई पारंपरिक नौकरियों के ख़त्म होने का डर है, जिससे बड़े पैमाने पर सामाजिक और आर्थिक बदलाव आ सकते हैं।

- Privacy Issues: AI को बड़ी मात्रा में डेटा की आवश्यकता होती है, जिससे यूज़र की privacy भंग होने का खतरा रहता है।

- Security Risks: AI का उपयोग गलत इरादों के लिए भी किया जा सकता है, जैसे cyber-attacks या surveillance के उन्नत तरीके।

- Lack of Transparency: कई advanced AI models, खासकर “black box” models, यह समझाना मुश्किल बना देते हैं कि वे कोई ख़ास निर्णय कैसे लेते हैं, जिससे accountability की कमी होती है।

इन चुनौतियों को समझना और उनका समाधान खोजना AI के सुरक्षित और ज़िम्मेदार विकास के लिए बेहद आवश्यक है।

AI Regulation की ज़रूरत क्यों?

AI के तेज़ विकास को देखते हुए, इसे regulate करना सिर्फ एक विकल्प नहीं बल्कि एक अनिवार्यता बन गया है। AI regulation की ज़रूरत को कई प्रमुख कारणों से समझा जा सकता है:

- Trust और Confidence बनाना: यदि लोगों को AI systems पर भरोसा नहीं होगा, तो वे उन्हें स्वीकार नहीं करेंगे। प्रभावी regulation यह सुनिश्चित करता है कि AI सिस्टम निष्पक्ष, पारदर्शी और सुरक्षित हों, जिससे यूज़र का विश्वास बढ़ता है।

- नुकसान से बचाव (Prevention of Harm): AI में व्यक्तियों और समाज को शारीरिक, आर्थिक, या मानसिक नुकसान पहुँचाने की क्षमता है। उदाहरण के लिए, bias AI systems गलत गिरफ्तारी या ऋण से इनकार कर सकते हैं। Regulation ऐसे harmful outcomes को रोकने में मदद करता है।

- नैतिक सिद्धांतों का पालन: AI के विकास और तैनाती में मानवीय मूल्यों और नैतिक सिद्धांतों का पालन सुनिश्चित करना। इसमें fairness, non-discrimination, human oversight और accountability शामिल हैं।

- Innovation को बढ़ावा देना: ऐसा लगता है कि regulation innovation को बाधित करता है, लेकिन उचित और स्पष्ट नियम वास्तव में innovation को सही दिशा दे सकते हैं। वे एक सुरक्षित और predictable framework प्रदान करते हैं जिसके भीतर कंपनियाँ सुरक्षित रूप से प्रयोग और विकास कर सकती हैं।

- Global Standards स्थापित करना: AI एक borderless technology है। विभिन्न देशों के बीच AI regulation में एकरूपता या कम से कम अनुकूलता वैश्विक सहयोग और AI के ज़िम्मेदार deployment के लिए महत्वपूर्ण है।

Regulation का उद्देश्य AI के विकास को रोकना नहीं, बल्कि यह सुनिश्चित करना है कि यह मानव-केंद्रित, नैतिक और समाज के व्यापक हित में हो।

विभिन्न Regulatory Frameworks और उनके Approaches

AI regulation एक जटिल क्षेत्र है, और दुनिया भर के देश इसे अलग-अलग approaches से संभाल रहे हैं। कोई भी “one-size-fits-all” समाधान नहीं है, और हर approach के अपने फायदे और नुकसान हैं:

- यूरोपीय संघ (EU AI Act): EU दुनिया का पहला व्यापक AI कानून “EU AI Act” लेकर आया है, जो एक risk-based approach अपनाता है। इसके तहत AI systems को उनके जोखिम के स्तर (unacceptable, high, limited, minimal) के आधार पर classify किया गया है।

- Unacceptable Risk: जैसे social scoring या manipulative techniques, जिन पर पूरी तरह प्रतिबंध है।

- High-Risk: healthcare, education, law enforcement जैसे क्षेत्रों में उपयोग होने वाले AI, जिनके लिए सख्त compliance requirements, human oversight और conformity assessments की आवश्यकता है।

- Limited & Minimal Risk: इन पर हल्के नियम या voluntary codes लागू होते हैं।

यह approach innovation को बढ़ावा देते हुए भी मानव अधिकारों और सुरक्षा को प्राथमिकता देती है।

- संयुक्त राज्य अमेरिका (USA): US का approach यूरोपीय संघ की तुलना में अधिक sector-specific और non-prescriptive रहा है। वहाँ innovation और economic growth पर अधिक ध्यान दिया जाता है। अलग-अलग agencies (जैसे NIST, FTC) विभिन्न क्षेत्रों के लिए guidelines और best practices जारी करती हैं। यहाँ self-regulation और voluntary industry standards को भी बढ़ावा दिया जाता है।

- चीन (China): चीन AI regulation में एक अधिक राज्य-नियंत्रित और शीर्ष-डाउन (top-down) approach अपनाता है। चीन ने AI के ethical guidelines और algorithms पर सख्त नियम बनाए हैं, खासकर data security, privacy और content regulation को लेकर। उनका ध्यान social stability और state control पर केंद्रित है, जबकि AI innovation को भी तेज़ी से बढ़ावा दिया जा रहा है।

- भारत (India): भारत अभी एक comprehensive AI regulation framework विकसित करने की प्रक्रिया में है। NITI Aayog और अन्य सरकारी निकाय AI के नैतिक उपयोग और governance पर चर्चा कर रहे हैं। भारत का focus AI for social good पर है, जिसमें accessibility, inclusion और equitable development पर जोर दिया गया है। भारत global discussions में भी सक्रिय रूप से भाग ले रहा है ताकि एक balanced और inclusive AI policy framework तैयार किया जा सके।

ये विभिन्न approaches दर्शाते हैं कि AI regulation एक विकसित होता हुआ क्षेत्र है जिसके लिए निरंतर चर्चा और अनुकूलन (adaptation) की आवश्यकता है।

AI Regulation का भविष्य और भारत की भूमिका

AI regulation का भविष्य लगातार विकसित हो रहा है और यह international cooperation, adaptive policies और multi-stakeholder engagement पर निर्भर करेगा।

- Adaptive Policies: AI technology इतनी तेज़ी से बदल रही है कि static regulations प्रभावी नहीं हो सकते। भविष्य के नियम लचीले (flexible) होने चाहिए जो नई तकनीकी प्रगति और उभरते जोखिमों के अनुसार ढल सकें।

- International Cooperation: AI की वैश्विक प्रकृति को देखते हुए, किसी भी देश के लिए अकेले प्रभावी ढंग से इसे regulate करना मुश्किल है। भविष्य में वैश्विक frameworks, standards और cross-border data governance agreements की आवश्यकता होगी। G7, G20 और संयुक्त राष्ट्र जैसे मंच इसमें महत्वपूर्ण भूमिका निभा सकते हैं।

- Multi-stakeholder Approach: सरकारों, उद्योग, शिक्षाविदों, नागरिक समाज और technical experts को मिलकर काम करना होगा ताकि comprehensive और practical regulations तैयार की जा सकें।

- Explainable AI (XAI) पर जोर: AI models के निर्णयों को समझना और व्याख्या करना regulation का एक केंद्रीय हिस्सा बन जाएगा, जिससे accountability और transparency बढ़ेगी।

भारत, दुनिया की सबसे बड़ी democracies में से एक और एक तेज़ी से बढ़ती हुई digital economy के रूप में, AI regulation के भविष्य को आकार देने में महत्वपूर्ण भूमिका निभा सकता है।

- AI for Social Good: भारत का “AI for All” का दृष्टिकोण AI के नैतिक और समावेशी उपयोग पर जोर देता है। भारत ऐसे policies को बढ़ावा दे सकता है जो AI को समाज के वंचित वर्गों तक पहुँचाने और असमानता को कम करने पर केंद्रित हों।

- Global Dialogue में सक्रिय भागीदारी: भारत वैश्विक मंचों पर एक strong voice बन सकता है, जो developing nations की चिंताओं और perspectives को सामने लाएगा। यह सुनिश्चित करेगा कि AI regulation केवल कुछ शक्तिशाली देशों के हितों का प्रतिनिधित्व न करे।

- Ethical Frameworks का विकास: भारत अपनी rich philosophical heritage और diverse सामाजिक ताने-बाने के आधार पर AI के लिए unique ethical frameworks विकसित कर सकता है जो वैश्विक चर्चाओं को समृद्ध करें।

- Balancing Innovation और Regulation: भारत एक ऐसा model प्रस्तुत कर सकता है जहाँ innovation को बिना समझौता किए ज़िम्मेदार regulation के साथ संतुलित किया जा सके, जिससे आर्थिक विकास और सामाजिक कल्याण दोनों सुनिश्चित हों।

AI regulation का भविष्य एक साझा जिम्मेदारी है, और भारत एक bridge-builder और thought leader के रूप में कार्य करके एक अधिक न्यायसंगत और सुरक्षित AI future बनाने में मदद कर सकता है।

AI के भविष्य को नियंत्रित करने के लिए AI regulation और policy का महत्व लगातार बढ़ रहा है। हमने देखा कि AI का तेज़ी से विकास कैसे नए अवसर और चुनौतियाँ दोनों पैदा कर रहा है। इन चुनौतियों का सामना करने, trust बनाने और नैतिक सिद्धांतों का पालन सुनिश्चित करने के लिए AI regulation एक अनिवार्य कदम है। दुनिया भर के देश, जैसे EU, US, और चीन, इस दिशा में अलग-अलग approaches अपना रहे हैं, जो risk-based से लेकर sector-specific और top-down control तक हैं। भारत अपनी बढ़ती digital economy और “AI for All” के दृष्टिकोण के साथ, वैश्विक AI policy dialogue में एक प्रमुख भूमिका निभाने के लिए तैयार है। भविष्य में adaptive policies, international cooperation और multi-stakeholder engagement की आवश्यकता होगी। अंततः, AI regulation का लक्ष्य innovation को रोकना नहीं, बल्कि एक ऐसा framework बनाना है जो AI के सकारात्मक प्रभावों को अधिकतम करे और इसके संभावित जोखिमों को कम करे, ताकि मानव-केंद्रित, सुरक्षित और ज़िम्मेदार AI का विकास हो सके।