नमस्कार! आजकल Artificial Intelligence (AI) और Robotics की चर्चा हर तरफ है। इन exciting fields में एक बहुत ही fundamental और important concept है ‘Robot Perception’। सीधे शब्दों में कहें तो, यह वह क्षमता है जिससे एक रोबोट अपने आसपास की दुनिया को ‘देख’ और ‘समझ’ पाता है। जैसे हम इंसान अपनी आँखों, कानों और अन्य इंद्रियों से अपने environment को perceive करते हैं, वैसे ही रोबोट्स को भी अपने sensors और advanced AI algorithms की मदद से यह perception develop करना होता है। यह सिर्फ देखने से बढ़कर है; इसमें data को interpret करना, objects को पहचानना, दूरी का अनुमान लगाना और अपने surroundings में navigate करना शामिल है। इस article में, हम Robot Perception के विभिन्न पहलुओं, इसे संभव बनाने वाली techniques और इसकी चुनौतियों पर विस्तार से चर्चा करेंगे।

Robot Perception: रोबोट कैसे “देखते” और “समझते” हैं?

Robot Perception, robotics का एक महत्वपूर्ण हिस्सा है जो रोबोट्स को अपने physical environment से information gather करने, उसे process करने और उसकी व्याख्या (interpret) करने में मदद करता है। यह रोबोट के लिए दुनिया को sense करने का तरीका है। अगर एक रोबोट अपने आसपास को समझ नहीं पाएगा, तो वह कोई भी meaningful task perform नहीं कर पाएगा, चाहे वह एक factory में सामान उठाना हो या किसी घर में मदद करना हो।

मान लीजिए एक autonomous car को सड़क पर चलना है। उसे traffic lights, pedestrians, दूसरी गाड़ियाँ और road signs को पहचानना होगा। यह सब Robot Perception के तहत आता है। इसमें सिर्फ data collect करना ही नहीं, बल्कि उस raw data को meaningful information में बदलना भी शामिल है, जिस पर रोबोट फिर कोई action ले सके। यह रोबोट के लिए आंखें, कान और दिमाग का काम करता है।

प्रमुख सेंसर्स और उनका उपयोग

Robot Perception की शुरुआत sensors से होती है। ये sensors रोबोट के लिए उसके ‘इंद्रियां’ होते हैं। विभिन्न प्रकार के sensors अलग-अलग प्रकार की information provide करते हैं:

- कैमरा (Cameras): ये 2D (normal photos) और 3D (depth information) दोनों तरह के visual data provide करते हैं। Stereo cameras या depth cameras (जैसे Intel RealSense, Microsoft Kinect) objects की दूरी और shape को समझने में मदद करते हैं। इन्हें object detection, recognition और tracking के लिए इस्तेमाल किया जाता है।

- LiDAR (Light Detection and Ranging): यह laser light का उपयोग करके दूरी को मापता है और environment का एक detailed 3D map बनाता है। Autonomous vehicles में यह बहुत popular है क्योंकि यह अंधेरे और कम रोशनी में भी अच्छा काम करता है। LiDAR point cloud data generate करता है जो surroundings का एक सटीक representation होता है।

- रडार (Radar): रेडियो तरंगों का उपयोग करके objects की दूरी, गति और दिशा का पता लगाता है। यह खराब मौसम (बारिश, कोहरा) में भी प्रभावी होता है, इसलिए यह automotive industry में एक महत्वपूर्ण sensor है।

- अल्ट्रासोनिक सेंसर्स (Ultrasonic Sensors): ये ध्वनि तरंगों (sound waves) का उपयोग करके objects की दूरी का पता लगाते हैं। ये अक्सर कम दूरी के लिए इस्तेमाल होते हैं और parking assistance systems में पाए जाते हैं। ये सस्ते और reliable होते हैं।

- टैक्टाइल सेंसर्स (Tactile Sensors): ये रोबोट को ‘छूने’ की अनुमति देते हैं। जैसे एक रोबोटिक आर्म किसी fragile item को उठा रहा हो, तो tactile sensors उसे यह समझने में मदद करेंगे कि उसे कितनी force लगानी है।

इन सभी sensors से collect किया गया data ही रोबोट के perception system का foundation होता है।

डेटा प्रोसेसिंग और व्याख्या (Interpretation)

Sensors से raw data collect करना केवल पहला कदम है। अगला और सबसे challenging कदम उस data को process करना और उसे meaningful information में interpret करना है। इसमें कई advanced techniques शामिल हैं:

- सेंसर फ्यूजन (Sensor Fusion): अलग-अलग sensors से मिले data को combine करके एक ज्यादा complete और accurate picture बनाना। उदाहरण के लिए, एक camera और LiDAR के data को combine करने से objects की पहचान और उनकी 3D location दोनों का बेहतर अनुमान लगाया जा सकता है। यह redundancy भी प्रदान करता है, जिससे एक sensor के fail होने पर भी system काम कर सकता है।

- कंप्यूटर विजन (Computer Vision): यह field visual data (images, videos) से information निकालने पर केंद्रित है। इसमें object detection (जैसे YOLO, SSD algorithms), object recognition (यह क्या object है?), और object tracking (object कहां जा रहा है?) जैसी techniques शामिल हैं। Deep Learning models ने कंप्यूटर विजन में क्रांति ला दी है।

- SLAM (Simultaneous Localization and Mapping): यह एक critical technique है जो रोबोट को एक ही समय में अपने environment का map बनाने और उस map में अपनी खुद की exact location का पता लगाने में सक्षम बनाती है। यह autonomous mobile robots के लिए indispensable है। जब रोबोट एक नई जगह पर जाता है, तो SLAM उसे बिना किसी pre-existing map के navigate करने में मदद करता है।

- पॉइंट क्लाउड प्रोसेसिंग (Point Cloud Processing): LiDAR जैसे 3D sensors से generate हुए point clouds को filter करना, segment करना और उनमें से objects को पहचानना।

यह प्रोसेसिंग रोबोट को सिर्फ यह बताने में मदद करती है कि “क्या है?” बल्कि यह भी बताती है कि “यह कहाँ है?” और “यह क्या कर रहा है?”

AI और Machine Learning का रोल

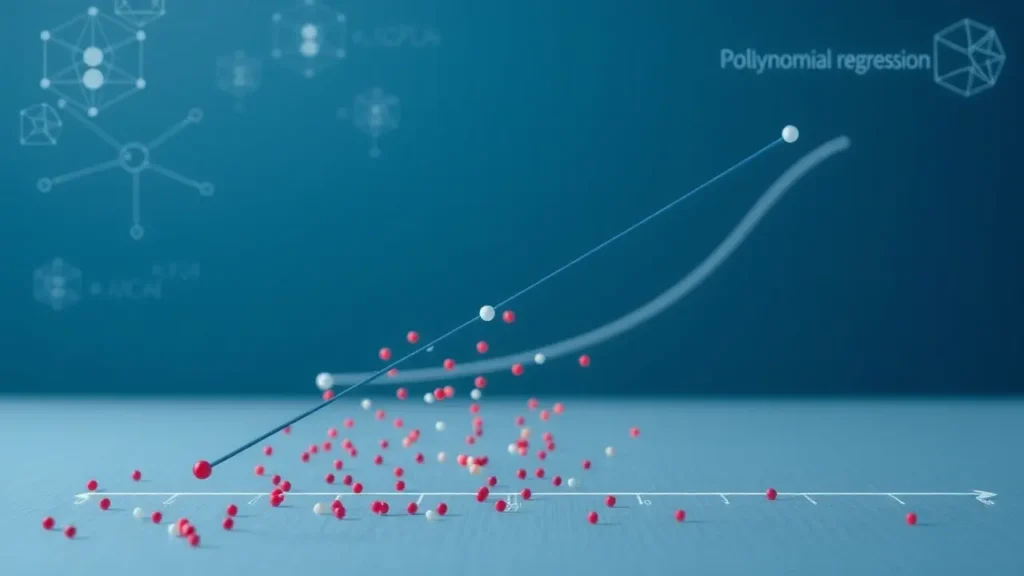

Robot Perception को आज जिस स्तर पर हम देखते हैं, वह Artificial Intelligence (AI) और Machine Learning (ML) की प्रगति के बिना संभव नहीं था। AI/ML algorithms, विशेष रूप से Deep Learning, raw sensor data से complex patterns और features सीखने में असाधारण रूप से अच्छे हैं:

- पैटर्न रिकॉग्निशन (Pattern Recognition): ML models को बड़ी मात्रा में data (जैसे लाखों images) पर train किया जा सकता है ताकि वे specific objects, faces, या patterns को पहचान सकें, भले ही वे अलग-अलग angles या lighting conditions में हों।

- ऑब्जेक्ट क्लासिफिकेशन और सेगमेंटेशन (Object Classification and Segmentation): Deep learning neural networks (जैसे Convolutional Neural Networks – CNNs) images में objects को न केवल classify कर सकते हैं (जैसे ‘यह एक कार है’), बल्कि उन्हें pixel-level पर segment भी कर सकते हैं (image के किस हिस्से में कार है)।

- प्रेडिक्टिव परसेप्शन (Predictive Perception): AI models केवल वर्तमान स्थिति को ही नहीं, बल्कि भविष्य की स्थितियों का अनुमान भी लगा सकते हैं। उदाहरण के लिए, एक autonomous car यह predict कर सकती है कि एक pedestrian अगले कुछ seconds में कहाँ होगा, जिससे collision से बचा जा सके।

- एडैप्टिव लर्निंग (Adaptive Learning): AI-powered perception systems अपने environment से लगातार सीख सकते हैं और समय के साथ अपनी performance को बेहतर बना सकते हैं। यह उन्हें नए scenarios और unforeseen challenges को adapt करने में मदद करता है।

संक्षेप में, AI रोबोट्स को केवल देखने के बजाय “समझने” और “सीखने” की क्षमता प्रदान करता है, जिससे उनका perception कहीं अधिक intelligent और robust हो जाता है।

चुनौतियाँ और भविष्य की दिशा

Robot Perception में काफी प्रगति हुई है, लेकिन अभी भी कई चुनौतियाँ हैं:

- वातावरणीय जटिलता (Environmental Complexity): cluttered environments, खराब मौसम (कोहरा, बारिश, बर्फ), और varied lighting conditions (दिन, रात, छाया) sensors और algorithms के लिए बड़ी चुनौतियाँ पेश करती हैं।

- रीयल-टाइम प्रोसेसिंग (Real-time Processing): खासकर autonomous driving या high-speed robotics में, perception systems को sensor data को बहुत तेज़ी से process और interpret करना होता है ताकि समय पर action लिया जा सके। इसके लिए powerful hardware और efficient algorithms की आवश्यकता होती है।

- अस्पष्टता और अनिश्चितता (Ambiguity and Uncertainty): कभी-कभी sensor data अस्पष्ट हो सकता है या उसमें शोर (noise) हो सकता है। ऐसे में सही व्याख्या करना मुश्किल हो जाता है।

- कंप्यूटेशनल लागत (Computational Cost): High-resolution sensors और complex AI models को चलाने के लिए काफी कंप्यूटेशनल पावर की आवश्यकता होती है, जो portable और energy-efficient robots के लिए एक चुनौती है।

भविष्य में, हम और भी advanced sensor technologies (जैसे event cameras जो सिर्फ changes को रिकॉर्ड करते हैं), अधिक robust और generalizable AI models, और explainable AI (XAI) तकनीकों को देखने की उम्मीद कर सकते हैं जो perception decisions को समझने में मदद करेंगी। Human-robot collaboration बढ़ने के साथ, robots को इंसानों के हावभाव और इरादों को समझने की क्षमता भी विकसित करनी होगी, जो perception का एक और complex layer है।

तो, अंत में हम कह सकते हैं कि Robot Perception आधुनिक robotics और AI का एक cornerstone है। यह वह जादू है जो रोबोट्स को केवल मशीनों से बदलकर intelligent agents में बदलता है जो अपने आसपास की दुनिया को न केवल sense कर सकते हैं बल्कि समझ भी सकते हैं। हमने देखा कि कैसे विभिन्न sensors (जैसे कैमरा, LiDAR) data collect करते हैं और फिर कैसे advanced techniques (जैसे Sensor Fusion, Computer Vision, SLAM) उस data को meaningful information में बदलते हैं। AI और Machine Learning, विशेष रूप से Deep Learning, ने इस प्रक्रिया को revolutionary बना दिया है, जिससे रोबोट्स की समझने और सीखने की क्षमता में अभूतपूर्व वृद्धि हुई है। चुनौतियों (जैसे complex environments, real-time processing) के बावजूद, इस क्षेत्र में research और development तेज़ी से आगे बढ़ रहा है। Robot Perception में हो रही प्रगति ही autonomous vehicles, industrial robots और service robots के भविष्य को आकार दे रही है, जिससे वे हमारे जीवन को और भी आसान और सुरक्षित बना सकेंगे। यह सिर्फ एक तकनीकी concept नहीं, बल्कि रोबोट्स को हमारे सह-अस्तित्व के लिए तैयार करने का एक महत्वपूर्ण कदम है।